案例介绍

跨境电商数仓项目

软件架构:

离线:MySql -> Spark-SQL(平台封装工具)-> Hive -> Spark-sql(WaterDrop) -> clickhouse

实时:MySql(binlog) -> canal -> Kafka -> Flink -> (kafka,HDFS) -> clickhouse

数据流向:

使用平台封装的 Spark-SQL 对mysql数据抽取写入Hive表中,对数据进行 脱敏,降噪,去异常,数据建模,数据聚合等操作,通过封装的WaterDrop 把数据导入到Clickhouse。部分明细数据推送click house提供即席查询

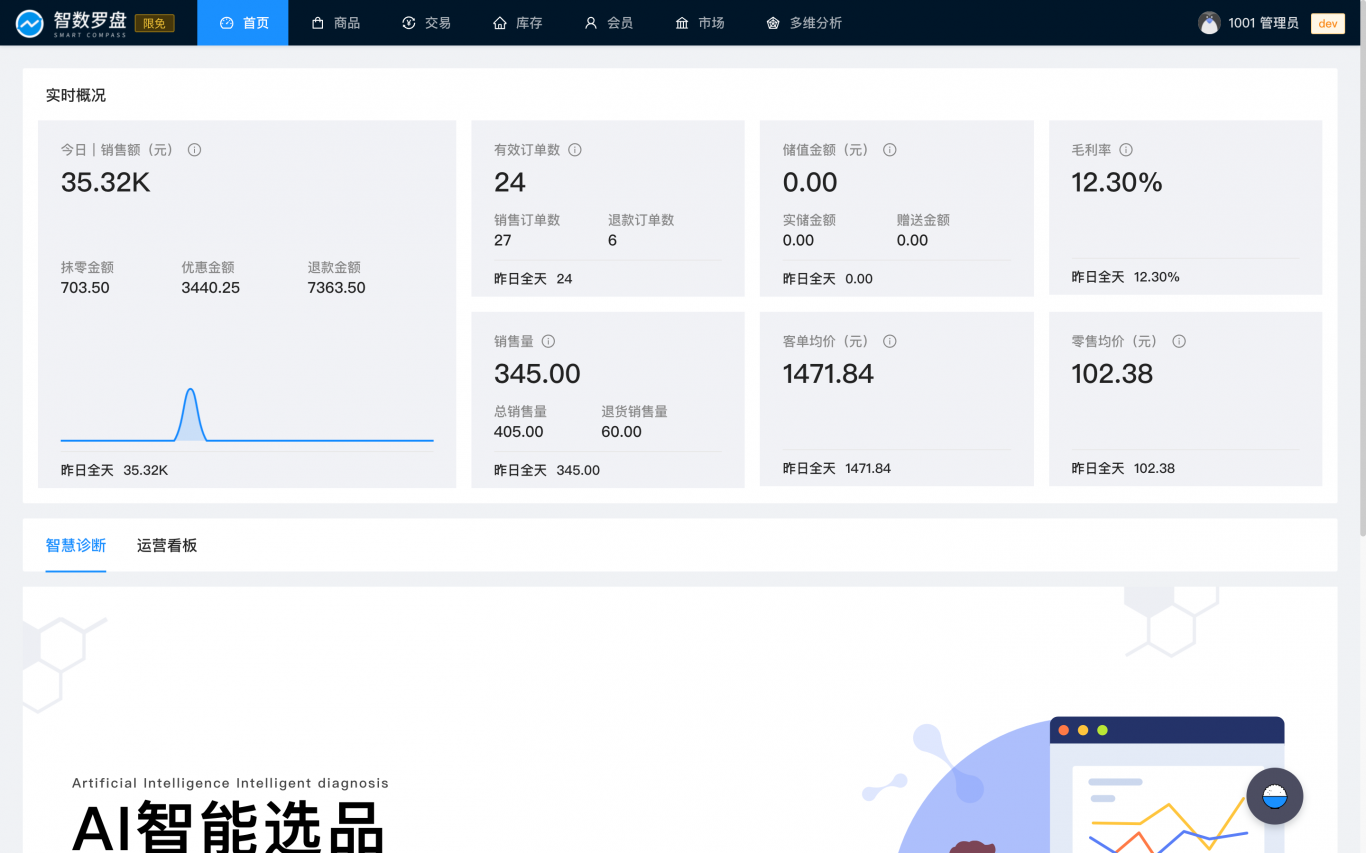

项目描述:

公司需要规划统一的数据管理/分析 平台,以及核心指标的实时监控。实时部分通过canal集群以及Flume日志采集工具采集实时生产的数据,对数据进行处理,落到ClickHouse,进行核心指标的分析和提取。

离线部分整合各个站点(可以理解为国家)的数据,进行统一建模,形成一致性维度。对数据进行拉宽,从DWS层推到ClickHouse,进行数据多维分析。

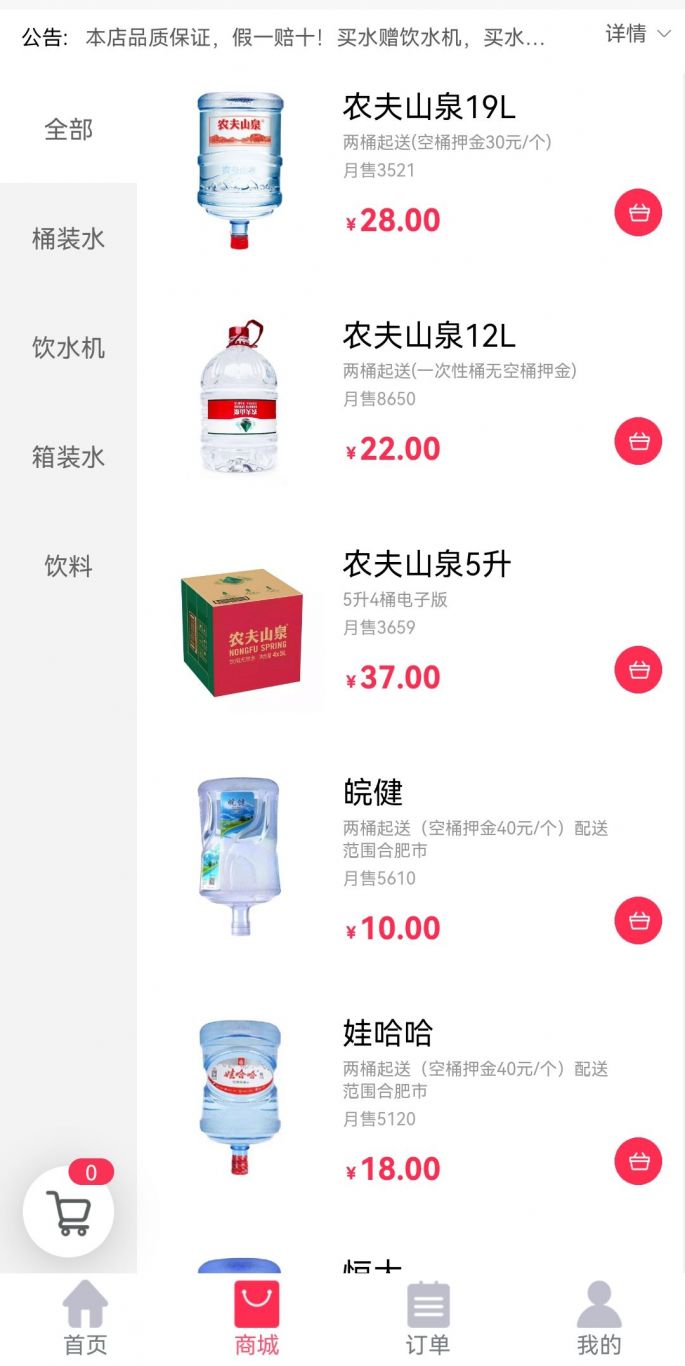

案例图片